¿Qué es Automatic Speech Recognition (ASR)?

El reconocimiento automático de voz (Automatic Speech Recognition) es un proceso para convertir automáticamente el habla en texto. Las tecnologías ASR utilizan técnicas de aprendizaje automático para analizar, procesar y generar texto a partir de patrones de voz. El Automatic Speech Recognition es útil para una variedad de aplicaciones, que van desde asistentes de voz virtuales hasta la creación de subtítulos para vídeos y la transcripción de reuniones importantes.

¿Qué significa Automatic Speech Recognition?

Automatic Speech Recognition (ASM), también conocido en español como el reconocimiento automático de voz, es un campo de la informática y la lingüística computacional. Este campo se centra en desarrollar métodos que permitan convertir automáticamente el habla en una forma legible por máquinas. Cuando el habla se convierte en texto, se habla también de Speech-to-Text (STT). Los métodos ASR se basan en modelos estadísticos y algoritmos complejos.

La precisión de un sistema ASR se mide mediante la llamada tasa de error de palabras (abreviado WER, del inglés Word Error Rate). Esta tasa compara el número de palabras omitidas, añadidas o mal reconocidas con el número total de palabras habladas. Cuanto menor sea el valor, mayor es la precisión del reconocimiento de voz. Por ejemplo, si la tasa de error es del 10%, la transcripción tiene una precisión del 90%.

¿Cómo funciona el Automatic Speech Recognition?

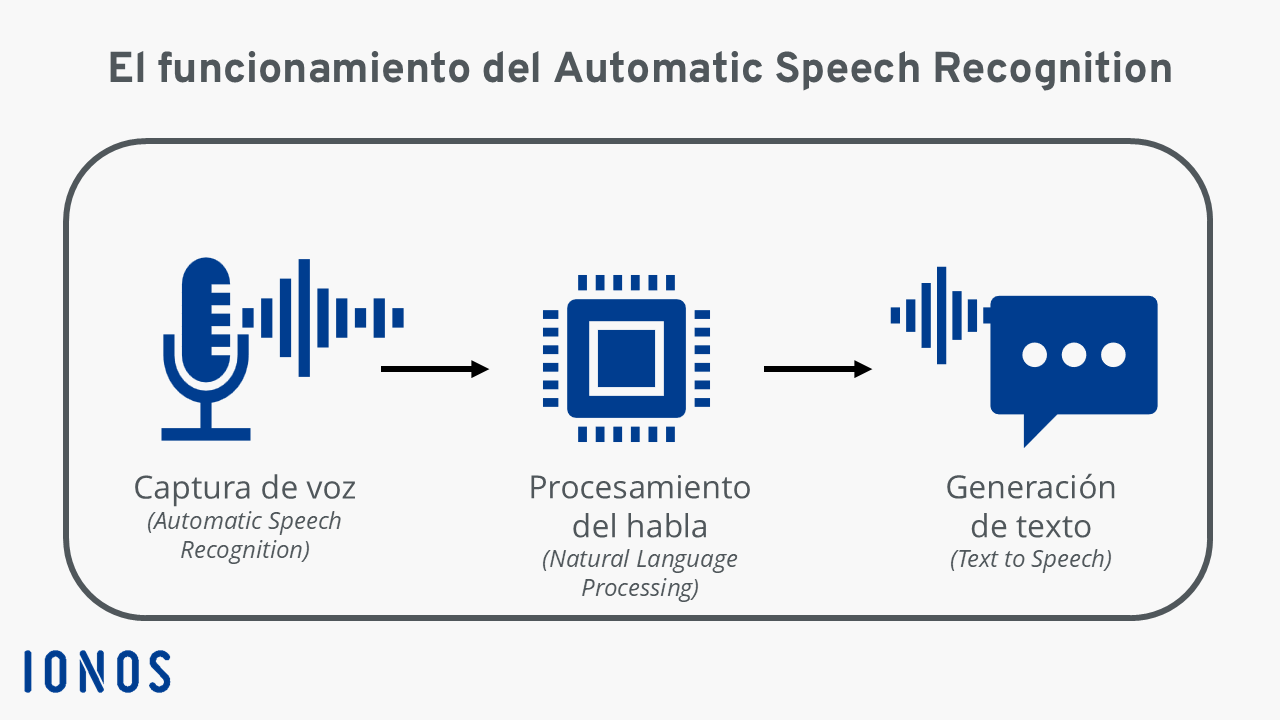

El reconocimiento automático de voz se compone de varios pasos consecutivos que se integran perfectamente entre sí. A continuación, se explican las diferentes fases de forma individual:

- Captura de voz (Automatic Speech Recognition): el sistema captura la voz hablada a través de un micrófono u otra fuente de audio.

- Procesamiento del habla (Natural Language Processing): primero, la grabación de voz se limpia de ruidos. A continuación, un algoritmo analiza las propiedades fonéticas y fonémicas del habla. Finalmente, los rasgos capturados se comparan con modelos entrenados previamente para identificar palabras individuales.

- Generación de texto (Speech to Text): en esta fase, el sistema convierte finalmente los sonidos reconocidos en texto.

Algoritmos ASR: enfoque híbrido vs. deep learning

Existen dos enfoques principales para el reconocimiento automático de voz. Mientras que en el pasado se usaban principalmente enfoques híbridos clásicos como los modelos ocultos de Markov, hoy en día se recurre cada vez más a las tecnologías de deep learning. Este cambio se debe a que la precisión de los modelos tradicionales ha llegado a su límite.

Enfoque híbrido clásico

Los modelos clásicos requieren datos alineados forzadamente, lo que significa que utilizan la transcripción textual de un segmento de audio para determinar dónde aparecen determinadas palabras. El enfoque híbrido combina siempre un modelo léxico, un modelo acústico y un modelo de lenguaje para transcribir el habla:

- El modelo léxico define la pronunciación fonética de las palabras. Es necesario crear un conjunto de datos o fonemas para cada idioma.

- El modelo acústico se encarga de modelar los patrones acústicos del habla. Con la ayuda de los datos alineados, genera predicciones sobre qué sonido o fonema corresponde a los distintos segmentos de voz.

- El modelo de lenguaje aprende qué secuencias de palabras son más probables en un idioma. Su tarea es predecir qué palabras tienen más probabilidades de seguir a las actuales.

El principal inconveniente del enfoque híbrido es que aumentar la precisión del reconocimiento de voz con este método es una tarea complicada. Además, es necesario entrenar tres modelos separados, lo que resulta ser muy costoso, además de consumir mucho tiempo. A pesar de esto, muchas empresas siguen optando por este enfoque debido a la gran cantidad de conocimientos disponibles sobre cómo crear modelos robustos mediante el enfoque clásico.

Deep learning con procesos End-to-End

Los sistemas de extremo a extremo pueden transcribir directamente una secuencia de características acústicas de entrada. El algoritmo aprende cómo transformar las palabras habladas utilizando una gran cantidad de pares de datos, que consisten en archivos de audio de una frase concreta y su transcripción correcta.

Las arquitecturas de deep learning como CTC, LAS y RNNT se pueden entrenar para generar resultados precisos sin necesidad de datos alineados forzadamente, ni de modelos léxicos o de lenguaje. Aun así, muchos sistemas de deep learning se combinan con un modelo de lenguaje, ya que puede ayudar a mejorar la precisión de la transcripción.

En nuestro artículo “Deep learning vs. machine learning”, te explicamos las diferencias entre estos dos conceptos.

Para el Automatic Speech Recognition, el enfoque de extremo a extremo (o End-to-End) no solo ofrece una mayor precisión en comparación con los modelos tradicionales. También supone una ventaja, ya que los sistemas ASR son más fáciles de entrenar y requieren menos intervención humana.

Automatic Speech Recognition: ¿cuáles son los principales campos de aplicación?

Gracias a los avances en el campo del machine learning, las tecnologías ASR se vuelven cada vez más precisas y potentes. El reconocimiento automático de voz puede aplicarse en muchas industrias para mejorar la eficiencia, aumentar la satisfacción del cliente y/o mejorar el retorno de inversión (abreviado ROI, del inglés Return on Investment). Los principales campos de aplicación incluyen:

- Telecomunicaciones: los centros de contacto utilizan tecnologías ASR para transcribir conversaciones con clientes y, finalmente, analizarlas. Las soluciones de seguimiento de llamadas y las soluciones telefónicas basadas en servidores en la nube también requieren transcripciones precisas.

- Plataformas de vídeo: hoy en día, la creación de subtítulos en tiempo real en las plataformas de vídeo es un estándar de la industria. El Automatic Speech Recognition también es útil para la categorización de contenidos.

- Monitorización de medios: las API de reconocimiento automático de voz permiten analizar programas de televisión, podcasts, radios y otros medios para identificar con qué frecuencia se mencionan determinadas marcas o temas.

- Videoconferencias: soluciones como Zoom, Microsoft Teams o Google Meet dependen de transcripciones precisas y análisis de los contenidos para extraer información clave y tomar decisiones. El Automatic Speech Recognition también se utiliza para proporcionar subtítulos en tiempo real durante videoconferencias.

- Asistentes de voz: ya sea Alexa de Amazon, el Asistente de Google o Siri de Apple, los asistentes virtuales se basan en el Automatic Speech Recognition. Esta tecnología permite que los asistentes respondan preguntas, ejecuten tareas e interactúen con otros dispositivos.

¿Qué papel juega la inteligencia artificial en las tecnologías ASR?

La inteligencia artificial ayuda a mejorar la precisión y la funcionalidad general de los sistemas de reconocimiento automático de voz. En particular, el desarrollo de grandes modelos de lenguaje ha permitido que hoy en día se pueda procesar mucho mejor el lenguaje natural. Un modelo de lenguaje extenso (LLM) no solo es capaz de crear textos complejos y traducciones con alta relevancia, sino que también reconoce el habla. Por lo tanto, los sistemas ASR se benefician considerablemente de estos avances. Además, la inteligencia artificial también resulta útil en el desarrollo de modelos de lenguaje específicos para distintos acentos.

- Crea tu página web en tiempo récord

- Impulsa tu negocio gracias al marketing por IA

- Ahorra tiempo y obtén mejores resultados

¿Cuáles son las ventajas y desventajas del Automatic Speech Recognition?

En comparación con la transcripción tradicional, el reconocimiento automático de voz ofrece varias ventajas. Uno de los puntos fuertes de los sistemas modernos de Automatic Speech Recognition es su alta precisión, debido a la capacidad de estos sistemas para entrenarse con grandes volúmenes de datos. Esto permite mejorar la calidad de los subtítulos y las transcripciones, además de ofrecer estos servicios en tiempo real.

Otra ventaja importante es el aumento de la eficiencia. El reconocimiento automático de voz o Automatic Speech Recognition permite a las empresas escalar, ampliar más rápidamente su gama de servicios y ofrecer estos a un público más amplio. Las herramientas con el reconocimiento automático de voz facilitan la documentación de contenidos de audio para estudiantes y profesionales, como en el caso de las reuniones empresariales o las clases universitarias.

Sin embargo, un inconveniente es que, aunque los sistemas de Automatic Speech Recognition son más precisos que nunca, todavía no alcanzan la precisión de los seres humanos. Esto se debe principalmente a las numerosas sutilezas del habla. Entre los desafíos se incluyen los acentos, los dialectos y las diferentes entonaciones, así como también los ruidos de fondo. Incluso los modelos más avanzados de deep learning no pueden cubrir todos los casos excepcionales. Otro aspecto problemático es que las tecnologías ASR a veces procesan datos personales, lo que plantea preocupaciones sobre la privacidad y la seguridad de los datos.